關于無人車的定位有兩種,一種稱為絕對定位,它直接給出無人車與地球或WGS84坐標系的相對坐標,即坐標(B,L,H),其中B是緯度,L是經度,H是地球與WGS-84橢球體的高度。WGS-84坐標系是由美國國防部開發和確定的大地坐標系,是一個商定的陸地坐標系。WGS-84坐標系定義為:原點為地球質心,空間直角坐標系的Z軸指向BIH(1984.0)定義的極點(CTP)的方向,即常規國際原點的CIO,由IAU和IUGG共同推薦。x軸指向由BIH定義的零子午線平面與CTP赤道的交點,y軸與z軸和x軸形成右手坐標系。WGS-84橢球體采用國際大地測量與地球物理聯合會第十七屆大會測量常數推薦值,并采用兩個常用的基本幾何參數:主半軸A=6378137m;

展平比f=1:298.19989.999999999895坐標系非常復雜,GPS測量結果與中國54系列或80系列坐標的差異在幾十米到100多米之間,而且不同地區的差異也不同。據粗略統計,西部與東北部的差距約為70米,140米,南部75米,在中間45米。在中國,為了安全起見,當地圖發布時,國家對坐標84進行了非線性偏移,得到的坐標稱為GCJ02坐標系。國內許多地圖公司,可能是由于業務需求或商業競爭的某些原因,在GCJ02坐標的基礎上又進行了一次非線性偏置,并建立了自己的坐標系。百度就是這樣一家公司。在GCJ02的基礎上,百度進行了BD-09二次非線性偏置,得到了自己的百度坐標系。傳統的GPS定位精度只有3-7米,中國城市主干道的單車道寬度一般為3.75米,這意味著GPS無法實現車道線定位。在城市道路或峽谷中,精度將進一步降低。即使在美國和北約國家,民用系統也不可能使用GPS進行亞米定位。GPS衛星廣播的信號包括載波、測距碼和數據碼三個信號分量。測距碼分為P碼(精細碼)和C/A碼。通常,C/A代碼稱為民代碼,P代碼稱為軍代碼。P碼將被細分為普通碼和W碼,完全不可能破解。后來,在新一代GPS上,美國提出了一種特殊的M(軍用)碼,其細節仍然高度保密,只知道速度為5.115MHz,碼長未知。目前北斗的定位精度不如全球定位系統。無人車車道線級別的絕對定位是一個難題,無人車需要更精確的厘米級定位。為了解決這個問題,日本開發了準天頂衛星系統(QZSS),該系統于2010年發射了一顆衛星,并于2017年又發射了三顆衛星,形成了三顆人造衛星的衛星增強系統,通過時間轉移完成全球定位系統的區域功能。它將于今年4月1日正式商業化。通過GPS系統,QZSS可以實現6厘米的定位。QZSS系統中L5信號的頻點也為1176.45MHz,在該頻點采用的碼率與GPS相同,均為10.23MHz。這意味著芯片制造商只需改變軟件處理即可實現與Galileo和QZSS的兼容性,而無需改變支持GPS系統的原芯片上的硬件,這相當于在軟件實現中搜索更多的導航衛星。這幾乎不會增加成本,而且北斗系統需要更換硬件,這非常麻煩。由于日本國土面積小,四顆衛星就足夠了。如果使用中國或美國,可能需要35-40顆衛星。國內大多數制造商使用GPS RTK進行絕對定位,但RTK的缺點也很明顯。RTK在確定整周模糊度方面的可靠性為95~99%,在穩定性方面不如全站儀,因為RTK容易受到衛星條件、天氣條件和數據鏈路傳輸條件的影響。首先,每天(在中國通常是下午)中、低緯度地區總有兩個GPS盲點,每次持續20~30分鐘。衛星幾何結構在盲點處的強度較低,因此RTK測量很難得到固定的解。其次,在白天的中午,由于電離層干擾,共享衛星的數量較少,因此初始化甚至初始化需要很長時間,無法測量。根據實踐經驗,RTK測量每天12:00至13:00很難得到固定的解。第三,依靠GPS信號,它不能在隧道和高層地區使用。阿波羅的先進定位技術無人車方案不能完全基于RTK。百度Apollo系統采用激光雷達、RTK和IMU融合的方案,多個傳感器的融合和誤差狀態卡爾曼濾波器使定位精度達到5-10厘米,具有高可靠性和魯棒性,達到世界頂級水平。城市地區的最高允許速度超過每小時60公里。

ta“src=”/eimg/jndp/ig/20230304013732503791/1.jpg“/>

上圖為百度Apollo自動駕駛傳感器、計算單元和控制前的連接圖。該計算系統使用省Neousys Nuvo-6108GC工業計算機,該計算機使用英特爾雙核E5-2658 V3 12核CPU。它主要用于處理激光雷達云點和圖像數據。在GPS定位和慣性測量單元方面,IMU為NovAtel IMU-IGM-A1,GPS接收器為NovAtelProPak6。激光雷達采用Velodyne HDL-64S3,通過以太網與工業計算機相連。水平視場為360,垂直視場為26.9,水平角分辨率為0.08,距離精度小于2厘米。它可以探測1.2億輛汽車或樹木。視覺系統使用Leopard Imaging Li USB 30-Ar023 ZWDR,帶3.0外殼,通過USB連接到工業計算機。使用Anson的200萬像素1080p傳感器AR0230AT和AP0202 ISP。視場寬度為58度,有效距離約為60-70米。毫米波雷達采用大陸ARS408-21,與CAN卡相連。CAN卡為德國ESD CAN PCIe/402-B4。

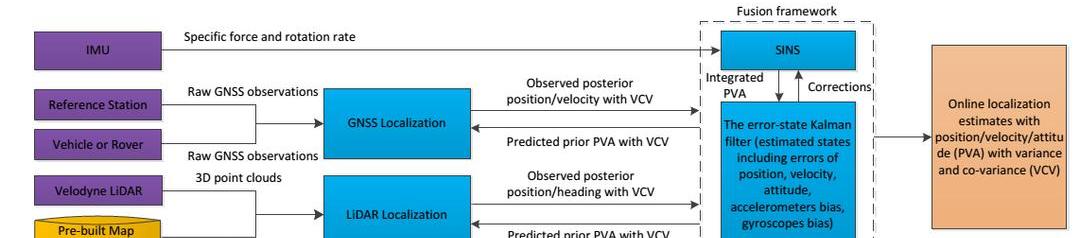

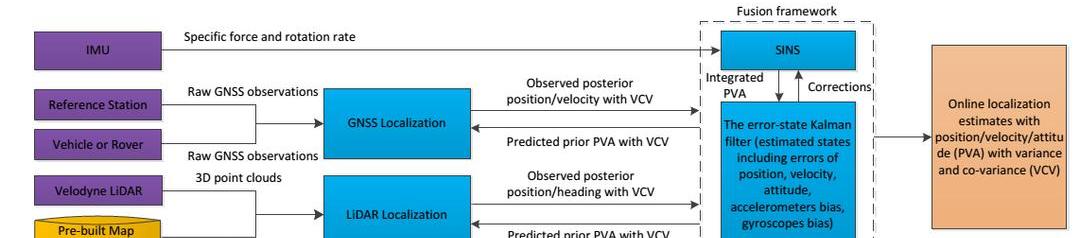

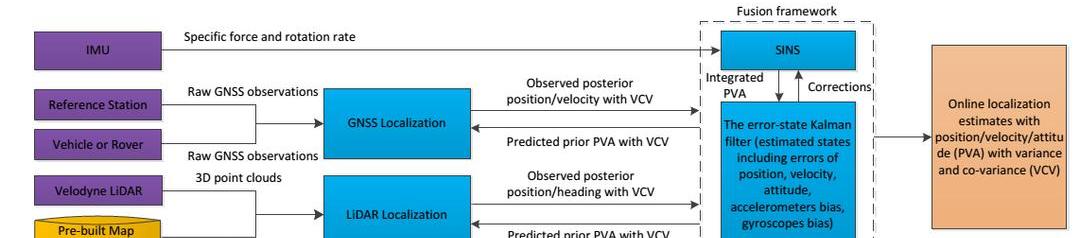

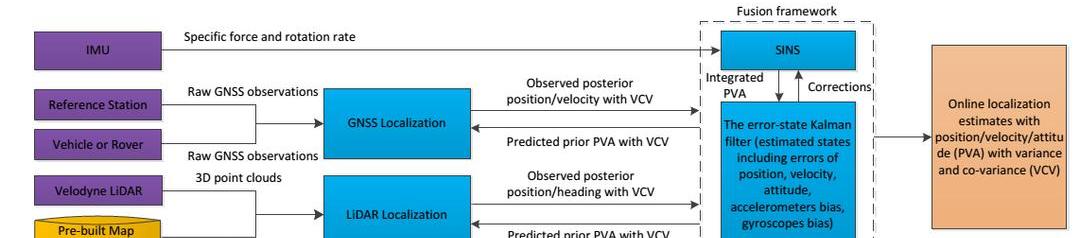

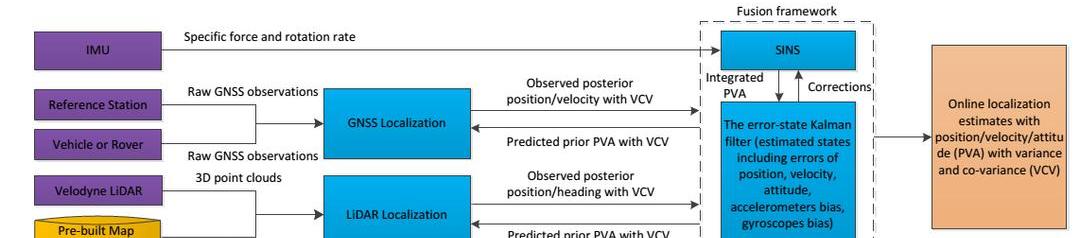

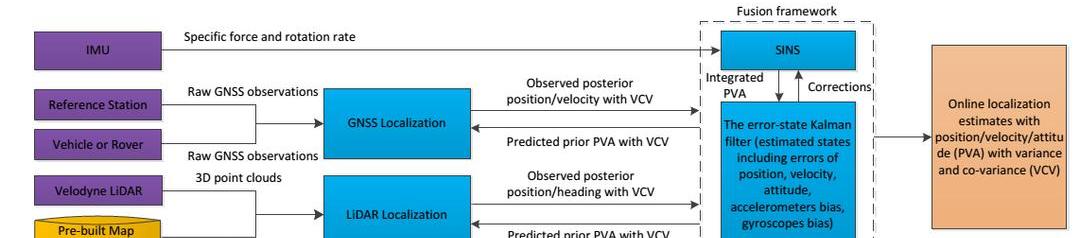

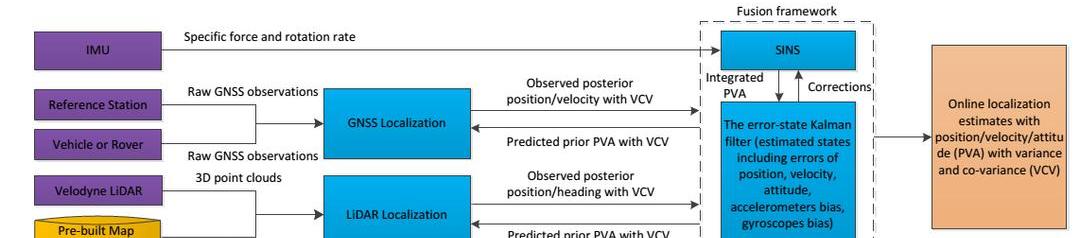

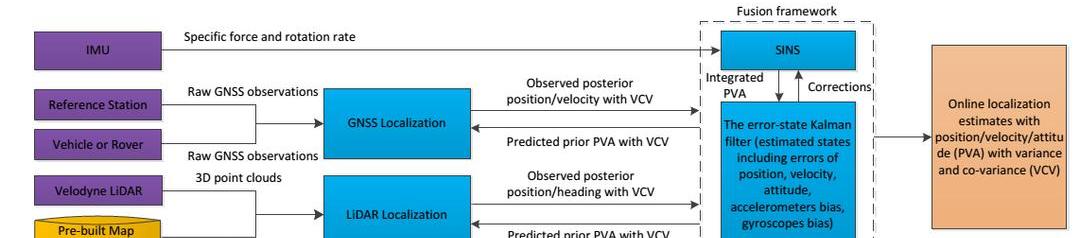

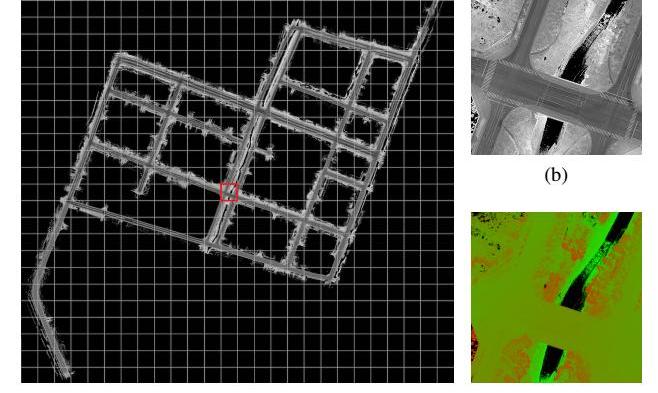

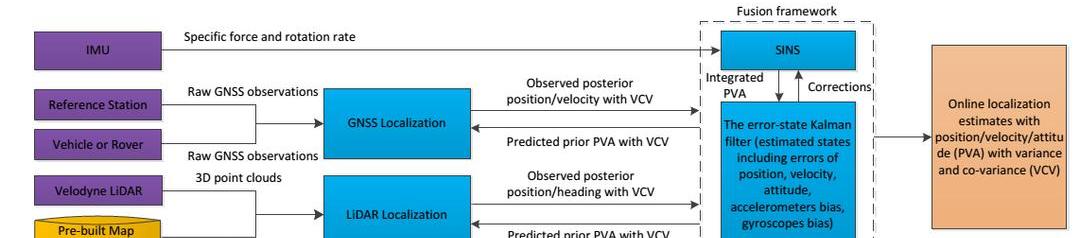

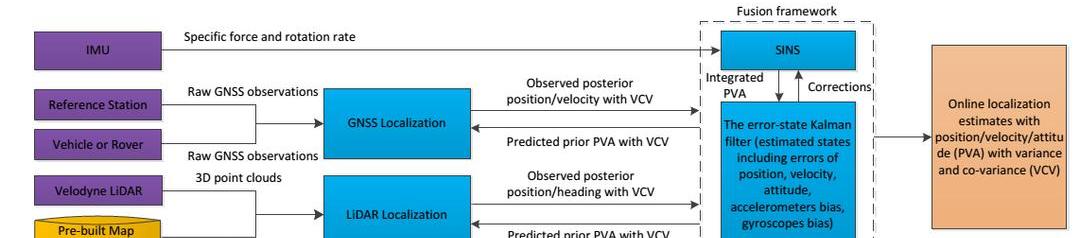

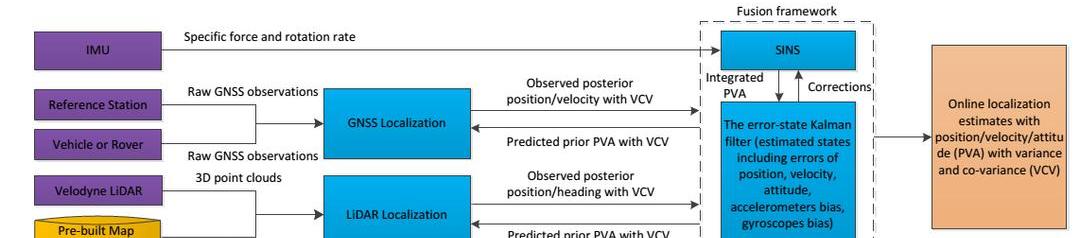

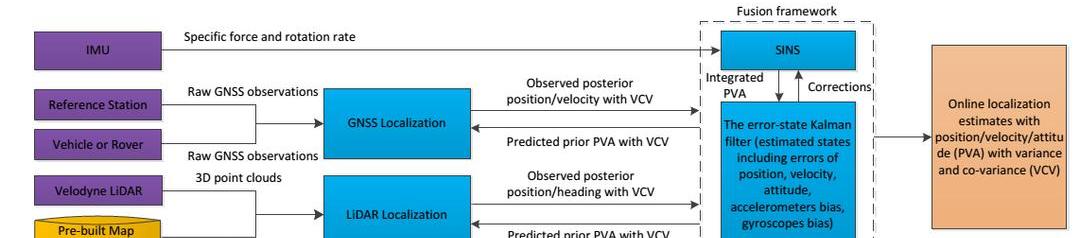

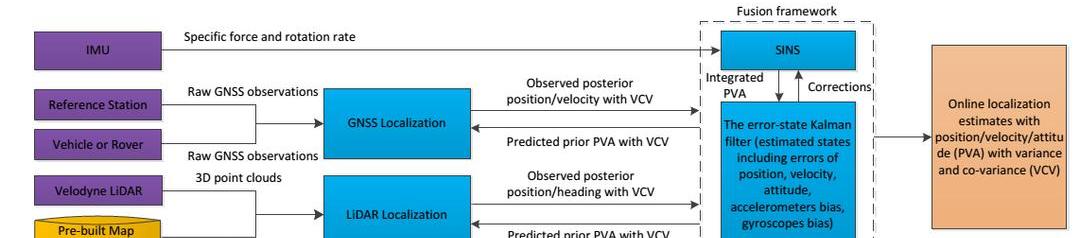

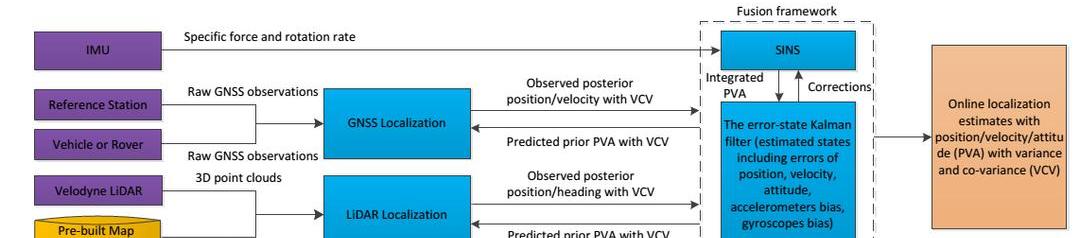

上圖顯示了百度無人車定位模塊的框架,該模塊結合了IMU、GNSS和激光雷達等傳感器(紫色)和預先制作的定位圖(黃色)。最頂層是SINS系統,即捷聯慣性導航系統。捷聯慣性導航系統是在平臺慣性導航系統的基礎上發展起來的。它是一個無框架系統,由三個速率陀螺儀、三個線性加速度計和一個處理器組成。SINS對IMU測量的加速度和角速度進行積分,得到位置、速度和姿態,作為卡爾曼濾波器傳播階段的預測模型。因此,卡爾曼濾波器將校正IMU的加速度和角速度,并且位置、速度和姿態等誤差也將反饋給SINS。RTK定位和激光雷達點云定位的結果被用作卡爾曼濾波器的測量更新。

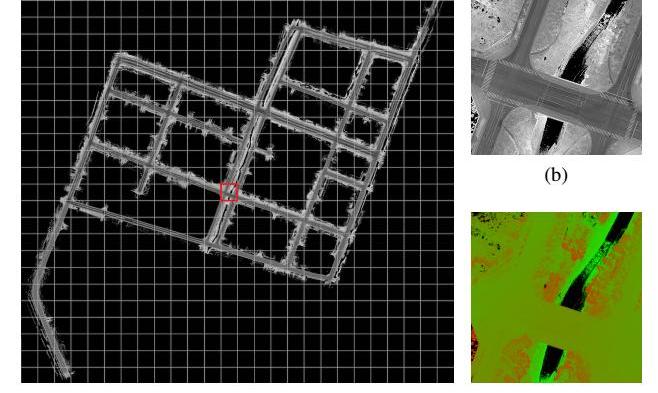

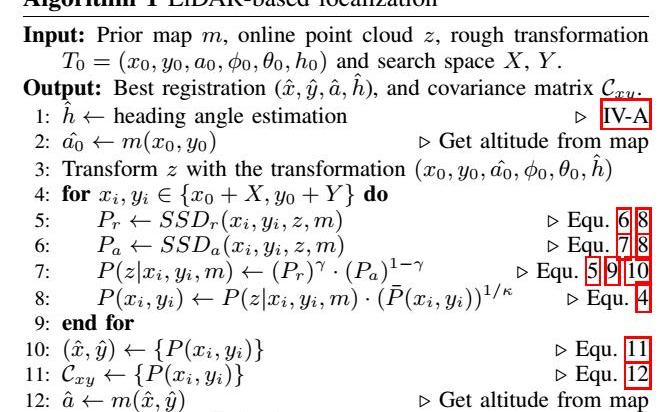

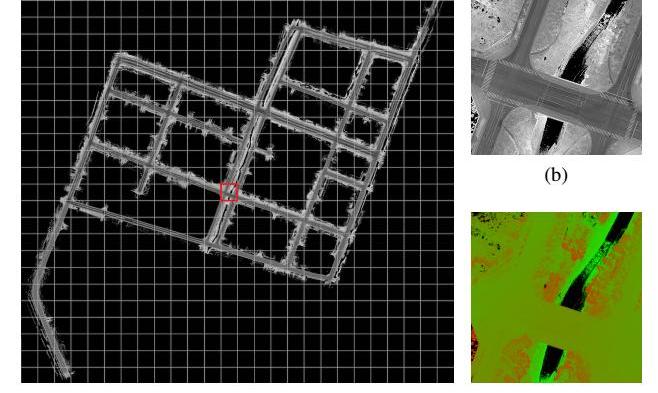

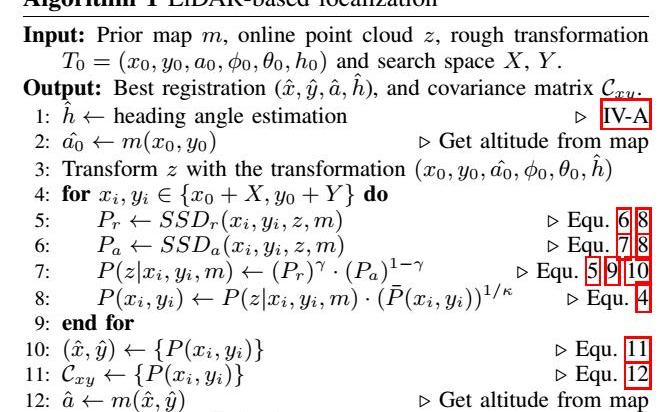

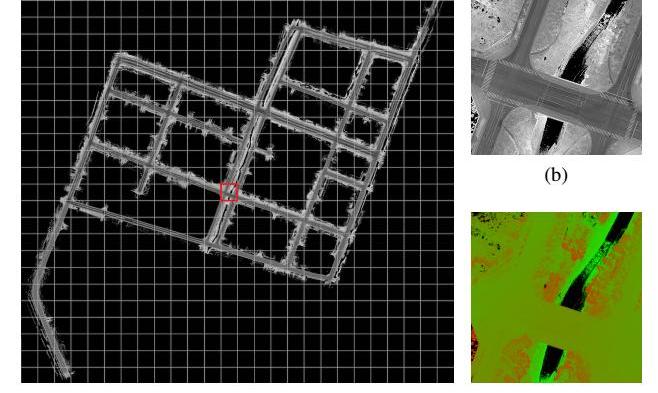

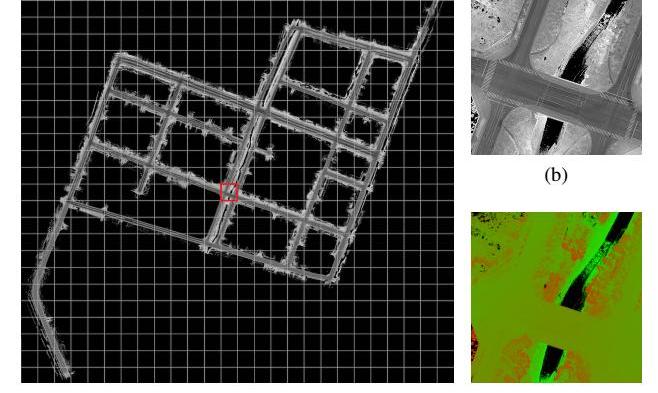

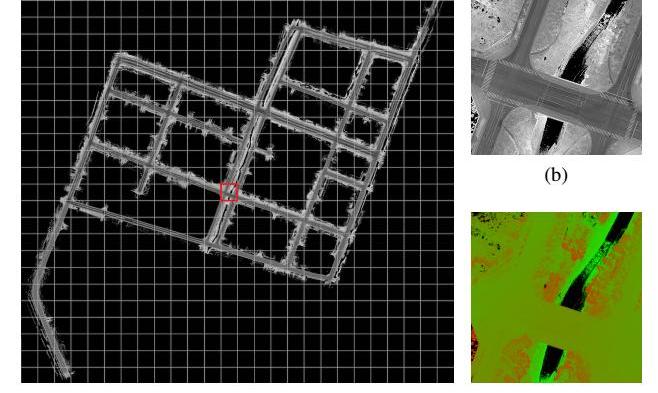

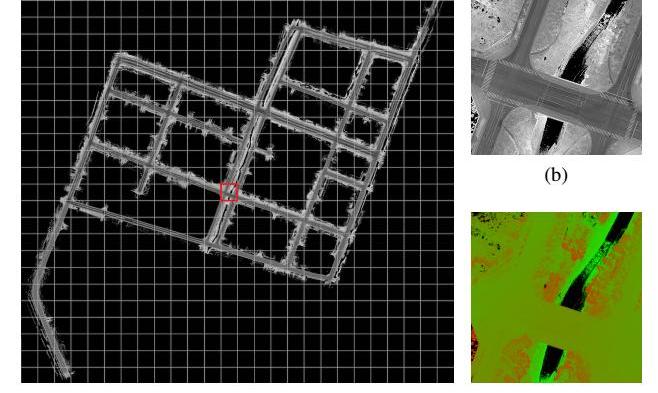

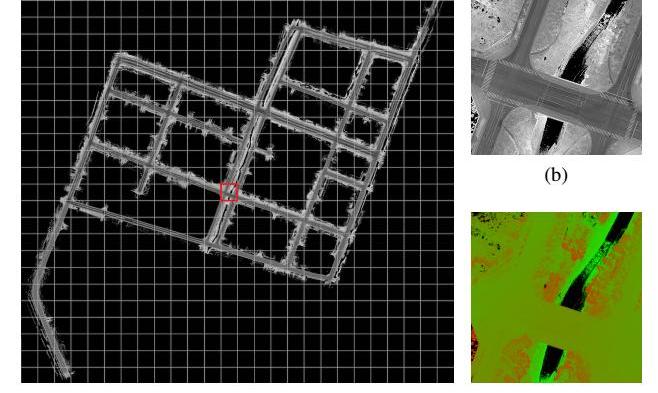

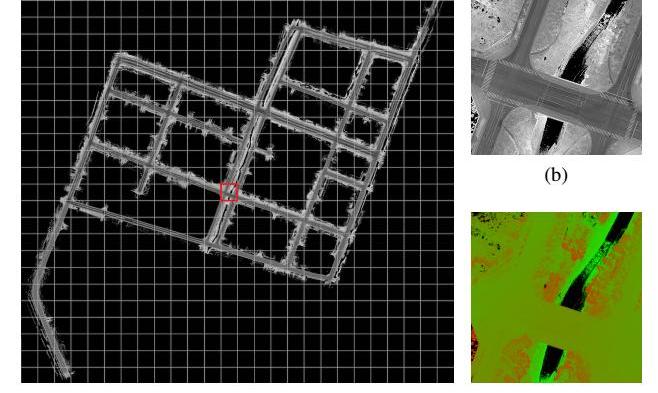

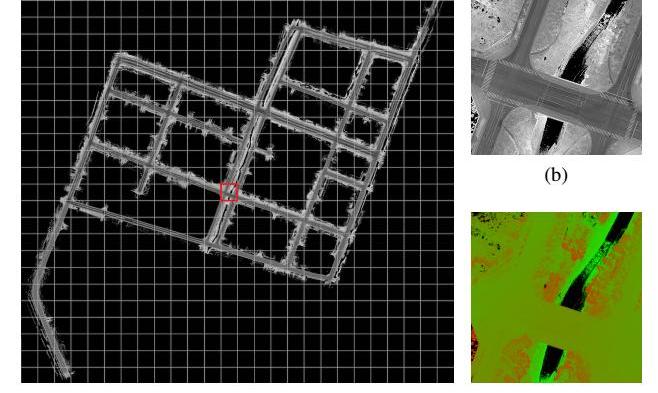

上圖為百度的激光雷達點云定位圖。首先,要提前制作無人車行駛區域的激光雷達點云定位圖,包括激光雷達的強度成像圖和高度分布圖。該地圖通常由地圖制造商使用測繪級激光雷達完成。目前,世界上絕大多數制造商,包括Waymo、Ford、GM等。B是激光雷達反射強度的成像圖,C是高度分布圖。這張地圖的面積為3.3*3.1平方公里。激光點云定位算法描述如下:

從表面上看,高精度定位非常復雜。在實際計算中,消耗的計算資源并不多,基于激光雷達的計算量遠低于基于圖像的計算量。未來,該系統也可以用傳統的汽車SoC來完成,如瑞薩的R-Car H3、恩智浦的I.MX8或S32A258C。預計成本將大大降低。64線激光雷達也有望在未來被閃光固態激光雷達所取代,從而大大降低成本。百度無人車定位團隊的一篇學術論文《基于多傳感器融合的多樣化城市場景下穩健精確的車輛定位》已被頂級機器人大會ICRA 2018聘用,初稿可從arXiv下載。Apollo的感知技術Apollo中的感知模塊具有以下功能:檢測目標(是否有障礙物)、對目標進行分類(障礙物是什么)、語義分割(對整個幀中的障礙物進行分類和渲染)以及目標跟蹤(障礙物跟蹤)。

Apollo 2.0系統利用多傳感器融合做環境感知,攝像頭負責紅綠燈的檢測,毫米波雷達最大的作用是提供目標的移動速度,目標識別主要由激光雷達完成。2016年10月,百度和清華聯合發表了一篇題為《自動駕駛多視圖三維物體檢測網絡》的論文,位于https://arxiv.org/pdf/1611.07759.pdf.本文使用激光雷達和相機的融合來……

確定目標。然而,在百度2017年5月發表的一篇論文《使用生產網絡的3D激光雷達車輛檢測》中,https://arxiv.org/pdf/1608.07916.pdf,放棄了與攝像頭的集成。2017年10月,增加了毫米波雷達融合。2017年11月,蘋果公司發表了一篇論文《體素網:僅使用激光雷達識別目標的基于點云的三維物體檢測的端到端學習》,并將其與百度和清華多視圖自動駕駛三維物體檢測網絡進行了比較,表明單用激光雷達的效果更好。原因是激光雷達的數據處理速度比相機快,時間同步非常困難,兩者的坐標需要統一;其次,相機對光線太敏感,可靠性低,尤其是在長距離拍攝時。在Apollo 2.0中,百度使用了激光雷達和毫米波雷達的融合方案。

激光雷達物體識別的最大優點是,無論白天還是晚上,無論是林蔭大道還是光線急劇變化的隧道出口,都可以完全消除光線的干擾。其次,激光雷達可以很容易地獲得深度信息,這對攝像系統來說是非常困難的。再次,激光雷達的有效距離遠高于攝像頭,進一步的有效距離等于增加了安全冗余。最后,在進行深度學習目標識別時,激光雷達的3D云點和相機的2D圖像容易出現透視失真。簡單地說,透視變形是指一個物體及其周圍區域與標準鏡頭中看到的完全不同,并且由于遠近特征的相對比例的變化而彎曲或變形。這是透鏡的固有特性(凸透鏡聚光,凹透鏡發散),因此無法消除,只能改進。這個問題在3D中不存在,因此用于3D圖像深度學習的神經網絡可以更簡單。此外,激光雷達還可以識別顏色和車道線。無人車領域目標圖像的識別不僅僅是識別,還包括分割和跟蹤。分割是用一個對象框住目標。對于2D圖像,只能使用2D幀來分割目標,而激光雷達圖像可以是3D幀,這更安全。跟蹤是預測車輛或行人可能的軌跡。

顯然,3D分割幀比2D分割幀更有價值,這也是Waymo和百度都使用激光雷達識別車輛的原因之一。DPM早期被用于目標檢測和識別領域。關于無人車的定位有兩種,一種稱為絕對定位,它直接給出無人車與地球或WGS84坐標系的相對坐標,即坐標(B,L,H),其中B是緯度,L是經度,H是地球與WGS-84橢球體的高度。WGS-84坐標系是由美國國防部開發和確定的大地坐標系,是一個商定的陸地坐標系。WGS-84坐標系定義為:原點為地球質心,空間直角坐標系的Z軸指向BIH(1984.0)定義的極點(CTP)的方向,即常規國際原點的CIO,由IAU和IUGG共同推薦。x軸指向由BIH定義的零子午線平面與CTP赤道的交點,y軸與z軸和x軸形成右手坐標系。WGS-84橢球體采用國際大地測量與地球物理聯合會第十七屆大會測量常數推薦值,并采用兩個常用的基本幾何參數:主半軸A=6378137m;

展平比f=1:298.19989.999999999895坐標系非常復雜,GPS測量結果與中國54系列或80系列坐標的差異在幾十米到100多米之間,而且不同地區的差異也不同。據粗略統計,西部與東北部的差距約為70米,140米,南部75米,在中間45米。在中國,為了安全起見,當地圖發布時,國家對坐標84進行了非線性偏移,得到的坐標稱為GCJ02坐標系。國內許多地圖公司,可能是由于業務需求或商業競爭的某些原因,在GCJ02坐標的基礎上又進行了一次非線性偏置,并建立了自己的坐標系。百度就是這樣一家公司。在GCJ02的基礎上,百度進行了BD-09二次非線性偏置,得到了自己的百度坐標系。傳統的GPS定位精度只有3-7米,中國城市主干道的單車道寬度一般為3.75米,這意味著GPS無法實現車道線定位。在城市道路或峽谷中,精度將進一步降低。即使在美國和北約國家,民用系統也不可能使用GPS進行亞米定位。GPS衛星廣播的信號包括載波、測距碼和數據碼三個信號分量。測距碼分為P碼(精細碼)和C/A碼。通常,C/A代碼稱為民代碼,P代碼稱為軍代碼。P碼將被細分為普通碼和W碼,完全不可能破解。后來,在新一代GPS上,美國提出了一種特殊的M(軍用)碼,其細節仍然高度保密,只知道速度為5.115MHz,碼長未知。目前北斗的定位精度不如全球定位系統。無人車車道線級別的絕對定位是一個難題,無人車需要更精確的厘米級定位。為了解決這個問題,日本開發了準天頂衛星系統(QZSS),該系統于2010年發射了一顆衛星,并于2017年又發射了三顆衛星,形成了三顆人造衛星的衛星增強系統,通過時間轉移完成全球定位系統的區域功能。它將于今年4月1日正式商業化。通過GPS系統,QZSS可以實現6厘米的定位。QZSS系統中L5信號的頻點也為1176.45MHz,在該頻點采用的碼率與GPS相同,均為10.23MHz。這意味著芯片制造商只需改變軟件處理即可實現與Galileo和QZSS的兼容性,而無需改變支持GPS系統的原芯片上的硬件,這相當于在軟件實現中搜索更多的導航衛星。這幾乎不會增加成本,而且北斗系統需要更換硬件,這非常麻煩。由于日本國土面積小,四顆衛星就足夠了。如果使用中國或美國,可能需要35-40顆衛星。國內大多數制造商使用GPS RTK進行絕對定位,但RTK的缺點也很明顯。RTK在確定整周模糊度方面的可靠性為95~99%,在穩定性方面不如全站儀,因為RTK容易受到衛星條件、天氣條件和數據鏈路傳輸條件的影響。首先,每天(在中國通常是下午)中、低緯度地區總有兩個GPS盲點,每次持續20~30分鐘。衛星幾何結構在盲點處的強度較低,因此RTK測量很難得到固定的解。其次,在白天的中午,由于電離層干擾,共享衛星的數量較少,因此初始化甚至初始化需要很長時間,無法測量。根據實踐經驗,RTK測量每天12:00至13:00很難得到固定的解。第三,依靠GPS信號,它不能在隧道和高層地區使用。阿波羅的先進定位技術無人車方案不能完全基于RTK。百度Apollo系統采用激光雷達、RTK和IMU融合的方案,多個傳感器的融合和誤差狀態卡爾曼濾波器使定位精度達到5-10厘米,具有高可靠性和魯棒性,達到世界頂級水平。城市地區的最高允許速度超過每小時60公里。

ta“src=”/eimg/jndp/ig/20230304013732503791/1.jpg“/>

上圖為百度Apollo自動駕駛傳感器、計算單元和控制前的連接圖。該計算系統使用省Neousys Nuvo-6108GC工業計算機,該計算機使用英特爾雙核E5-2658 V3 12核CPU。它主要用于處理激光雷達云點和圖像數據。在GPS定位和慣性測量單元方面,IMU為NovAtel IMU-IGM-A1,GPS接收器為NovAtelProPak6。激光雷達采用Velodyne HDL-64S3,通過以太網與工業計算機相連。水平視場為360,垂直視場為26.9,水平角分辨率為0.08,距離精度小于2厘米。它可以探測1.2億輛汽車或樹木。視覺系統使用Leopard Imaging Li USB 30-Ar023 ZWDR,帶3.0外殼,通過USB連接到工業計算機。使用Anson的200萬像素1080p傳感器AR0230AT和AP0202 ISP。視場寬度為58度,有效距離約為60-70米。毫米波雷達采用大陸ARS408-21,與CAN卡相連。CAN卡為德國ESD CAN PCIe/402-B4。

上圖顯示了百度無人車定位模塊的框架,該模塊結合了IMU、GNSS和激光雷達等傳感器(紫色)和預先制作的定位圖(黃色)。最頂層是SINS系統,即捷聯慣性導航系統。捷聯慣性導航系統是在平臺慣性導航系統的基礎上發展起來的。它是一個無框架系統,由三個速率陀螺儀、三個線性加速度計和一個處理器組成。SINS對IMU測量的加速度和角速度進行積分,得到位置、速度和姿態,作為卡爾曼濾波器傳播階段的預測模型。因此,卡爾曼濾波器將校正IMU的加速度和角速度,并且位置、速度和姿態等誤差也將反饋給SINS。RTK定位和激光雷達點云定位的結果被用作卡爾曼濾波器的測量更新。

上圖為百度的激光雷達點云定位圖。首先,要提前制作無人車行駛區域的激光雷達點云定位圖,包括激光雷達的強度成像圖和高度分布圖。該地圖通常由地圖制造商使用測繪級激光雷達完成。目前,世界上絕大多數制造商,包括Waymo、Ford、GM等。B是激光雷達反射強度的成像圖,C是高度分布圖。這張地圖的面積為3.3*3.1平方公里。激光點云定位算法描述如下:

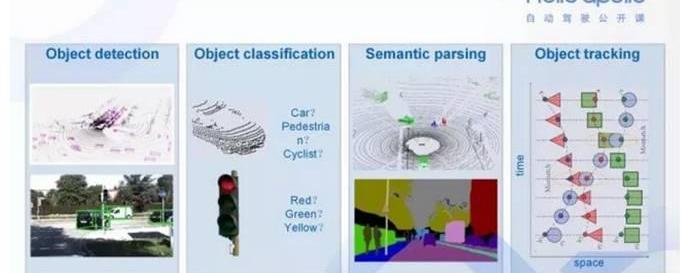

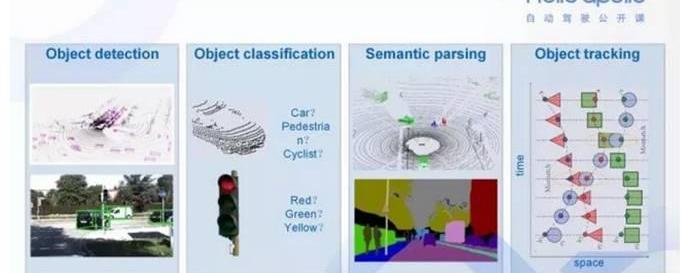

從表面上看,高精度定位非常復雜。在實際計算中,消耗的計算資源并不多,基于激光雷達的計算量遠低于基于圖像的計算量。未來,該系統也可以用傳統的汽車SoC來完成,如瑞薩的R-Car H3、恩智浦的I.MX8或S32A258C。預計成本將大大降低。64線激光雷達也有望在未來被閃光固態激光雷達所取代,從而大大降低成本。百度無人車定位團隊的一篇學術論文《基于多傳感器融合的多樣化城市場景下穩健精確的車輛定位》已被頂級機器人大會ICRA 2018聘用,初稿可從arXiv下載。Apollo的感知技術Apollo中的感知模塊具有以下功能:檢測目標(是否有障礙物)、對目標進行分類(障礙物是什么)、語義分割(對整個幀中的障礙物進行分類和渲染)以及目標跟蹤(障礙物跟蹤)。

Apollo 2.0系統利用多傳感器融合做環境感知,攝像頭負責紅綠燈的檢測,毫米波雷達最大的作用是提供目標的移動速度,目標識別主要由激光雷達完成。2016年10月,百度和清華聯合發表了一篇題為《自動駕駛多視圖三維物體檢測網絡》的論文,位于https://arxiv.org/pdf/1611.07759.pdf.本文使用激光雷達和相機的融合來……

確定目標。然而,在百度2017年5月發表的一篇論文《使用生產網絡的3D激光雷達車輛檢測》中,https://arxiv.org/pdf/1608.07916.pdf,放棄了與攝像頭的集成。2017年10月,增加了毫米波雷達融合。2017年11月,蘋果公司發表了一篇論文《體素網:僅使用激光雷達識別目標的基于點云的三維物體檢測的端到端學習》,并將其與百度和清華多視圖自動駕駛三維物體檢測網絡進行了比較,表明單用激光雷達的效果更好。原因是激光雷達的數據處理速度比相機快,時間同步非常困難,兩者的坐標需要統一;

其次,相機對光線太敏感,可靠性低,尤其是在長距離拍攝時。在Apollo 2.0中,百度使用了激光雷達和毫米波雷達的融合方案。

激光雷達物體識別的最大優點是,無論白天還是晚上,無論是林蔭大道還是光線急劇變化的隧道出口,都可以完全消除光線的干擾。其次,激光雷達可以很容易地獲得深度信息,這對攝像系統來說是非常困難的。再次,激光雷達的有效距離遠高于攝像頭,進一步的有效距離等于增加了安全冗余。最后,在進行深度學習目標識別時,激光雷達的3D云點和相機的2D圖像容易出現透視失真。簡單地說,透視變形是指一個物體及其周圍區域與標準鏡頭中看到的完全不同,并且由于遠近特征的相對比例的變化而彎曲或變形。這是透鏡的固有特性(凸透鏡聚光,凹透鏡發散),因此無法消除,只能改進。這個問題在3D中不存在,因此用于3D圖像深度學習的神經網絡可以更簡單。此外,激光雷達還可以識別顏色和車道線。無人車領域目標圖像的識別不僅僅是識別,還包括分割和跟蹤。分割是用一個對象框住目標。對于2D圖像,只能使用2D幀來分割目標,而激光雷達圖像可以是3D幀,這更安全。跟蹤是預測車輛或行人可能的軌跡。

顯然,3D分割幀比2D分割幀更有價值,這也是Waymo和百度都使用激光雷達識別車輛的原因之一。DPM早期被用于目標檢測和識別領域。2013年11月,目標檢測領域公認的大神Ross Girschick推出了R-CNN,并于2015年4月演變為Fast R-CNN,2015年6月演變為Fast R-CNN。它已經成為當今目標檢測和識別領域公認的最佳方法,并且可以完全實現端到端。FasterR-CNN也用于激光雷達的目標探測和識別。自2015年底以來,Faster R-CNN已經過去了近兩年,但它仍然是ObjectDetection領域的主流框架之一。盡管已經引入了改進的框架,如R-FCN和Mask R-CNN,但基本結構沒有太大變化。同時,還有許多新作品,如SSD和YOLO,但Faster R-CNN在準確性方面仍然是最好的。從本文中的RCNN到快速RCNN,再到fast RCNN,目標檢測的四個基本步驟(候選區域生成、特征提取、分類和位置細化)最終統一為一個深度網絡框架。所有計算都不重復,完全在GPU中完成,大大提高了運行速度。 4

4

圖像語義分割可以說是圖像理解的基石技術,在自動駕駛系統(具體而言,街景識別和理解,判斷駕駛區域)、無人機應用(著陸點判斷)和可穿戴設備應用中發揮著重要作用。圖像由許多像素組成,顧名思義,“語義分割”是根據圖像中表達的不同語義對像素進行分組/分割。語義分割有時是最困難的部分,因為它需要NLP自然語言處理的技能,而大多數玩CNN的人對NLP不是很了解。

5

5

上圖為斯坦福大學激光雷達語義分割的流程圖。最后,使用3D FC-RF,即完全連接的條件隨機場。另一種常用的方法是MRF和馬爾可夫隨機場。將條件隨機場用于自然語言處理,如序列標記和數據分割,取得了良好的效果。它在中文分詞、中文名稱識別和歧義解決等方面都有應用。百度的語義分割主要是為了更好地理解流量場景,為行為決策提供依據。低成本unm……

ned駕駛還可以使用相機的2D圖像進行語義分割,以找出無人車的駕駛區域。這種低成本的方案可以在光線好的情況下使用。除了激光雷達,2018年CES展出的Apollo2.0無人車頂部增加了兩個攝像頭,一個長焦和一個短焦,主要用于識別道路上的紅綠燈。自動駕駛訓練數據集KITTI數據集是由德國卡爾斯魯厄理工學院和豐田美國理工學院共同創立的自動駕駛場景中的計算機視覺算法評估數據集。該數據集用于評估計算機視覺技術在車輛環境中的性能,如立體圖像、光流、視覺里程計、3D物體檢測和3D跟蹤。KITTI包含從城市、農村和高速公路場景中收集的真實圖像數據,每張圖像中最多有15輛汽車和30名行人,以及不同程度的遮擋和截斷。

6

6

Cityscapes數據集主要由梅賽德斯-奔馳公司推廣,提供無人環境下的圖像分割數據集。它用于評估視覺算法在城市場景語義理解方面的性能。城市景觀包含了50個城市不同場景、背景和季節的街景,提供了5000張精細標記的圖像、20000張粗略標記的圖像和30種標記的物體。3月8日,百度正式開放ApolloScape大型自動駕駛數據集。ApolloScape的數據是Cityscapes等類似數據集的10倍以上,包括感知、模擬場景和路網數據等數十萬高分辨率圖像數據,這些數據被逐像素進行語義分割和標記,進一步覆蓋了更復雜的環境、天氣和交通狀況。ApolloScape數據集涵蓋了更復雜的道路條件,例如單個圖像中多達162輛車輛或80名行人,開放數據集采用逐像素的語義分割和標記。Kitti、Cityscapes和ApoloScape的數據示例比較

7

7

對于中國的傳統汽車制造商來說,自建培訓數據集可能是最大的問題,與百度合作是最好的選擇。3月31日,北京“你好Apollo,自動駕駛公開課”在2018年CES上,百度發布了Apollo 2.0,搭載百度Apollo 2.0-系統的自動駕駛汽車將具備簡單城市道路的自動駕駛能力。Apollo 2.0的發布也意味著百度的整體自動駕駛系統已經開放,包括云服務平臺、軟件平臺、參考硬件平臺和參考車輛平臺。阿波羅自動駕駛公開課程第三期將于3月31日在北京舉行,將引導自動駕駛開發者深入應用Apollo2.0。本次公開課邀請了百度自動駕駛部門的高級工程師和Apollo的老用戶與開發者交流,快速掌握Apollo2.0的最新功能。負責產品解決方案的百度自動駕駛事業部高級架構師楊帆將介紹Apollo開放平臺的引入、Apollo能力開放、Apollon資源開放和研發迭代的新模式以及Apollo生態舞臺的成果。設計并建造Apollo多傳感器融合定位系統的百度無人車定位技術負責人萬國偉將介紹Apollo2.0多傳感器融合導航模塊。無人車定位技術是自動駕駛領域的基礎技術之一,其難點在于如何保證高精度和高魯棒性。Apollo2.0的多傳感器融合定位模塊自適應地使用GNSS、激光雷達和IMU等傳感器,并在許多具有挑戰性的場景(如城市地區和隧道)中實現厘米級定位。萬國偉的演講將分享定位模塊的框架以及每個子模塊的算法原理。長沙智能駕駛研究院產品部負責人黃英軍從事智能駕駛的整體解決方案和產品研發,并將在沙龍上介紹“Apollo分布式可擴展計算平臺的探索”。黃英俊的分享主要包括:Jetson TX2上的Docker擴展和運行Apollo

; 在Jetson TX2上的Apollo中配置了TensorRT和VisionWorks的自適應功能,以優化和加速視覺算法。智行哲科技聯合創始人&;技術研發部總監李曉飛將在沙龍上分享“智能駕駛員案例——阿波羅合作落地低速自動駕駛專用車產品”,主要包括自動駕駛落地場景和應用挑戰、智能駕駛員AVOS系統的研發、,以及Intelligent Driver與Apollo之間的技術合作。

8

8

9

9

演講者簡介

0

0

楊帆:百度自動駕駛事業部高級架構師,負責產品解決方案。演講摘要:阿波羅開放平臺介紹、阿波羅能力開放介紹、阿波羅資源開放和研發迭代新模式、阿波羅生態階段成果。

1

1

萬國偉:百度無人車定位技術和Apollo核心算法技術負責人,設計并構建了Apollo多傳感器融合定位系統。摘要:無人車定位技術是自動駕駛領域的基礎技術之一,其難點在于如何保證高精度和高魯棒性。Apollo2.0的多傳感器融合定位模塊自適應地使用GNSS、激光雷達和IMU等傳感器,并在許多具有挑戰性的場景(如城市地區和隧道)中實現厘米級定位。本次講座將分享定位模塊的框架以及每個子模塊的算法原理。

2

2

黃英軍:長沙市智能駕駛研究院產品部部長,從事智能駕駛整體解決方案和產品研發,探索Apollo的分布式擴展。摘要:隨著智能駕駛技術平臺和系統架構的快速發展,許多制造商都提出了自己的系統架構和解決方案,但目前還沒有占主導地位的解決方案。Apollo集中運行感知、決策和控制模塊,對資源、實時性能和可靠性有不同要求,對計算平臺、操作系統和運行環境也有不同要求。我們共享的是,這些模塊是解耦的,并以分布式和集成的方式在不同的計算平臺和操作系統上運行,即決策和控制模塊在高度可靠的雙機備份低成本平臺上運行,并且傳感模塊在幾個低成本和高性能的技術平臺上運行,以實現分布式和可擴展的解決方案。這種共享主要包括:Jetson TX2上的Docker擴展和運行Apollo

; 在Jetson TX2上的Apollo中配置了TensorRT和VisionWorks的自適應功能,以優化和加速視覺算法。

3

3

李曉飛:智行哲科技聯合創始人;

技術研發部部長。演講摘要:自動駕駛產品落地為何如此困難?困惑,自動駕駛應用場景的出路在哪里?團結就是力量,智者和阿波羅怎么能齊頭并進?本文主要介紹了自動駕駛著陸場景及應用挑戰、智能步行者AVOS系統的研發以及智能步行者與Apollo的技術合作三個部分。

4 2013年11月,目標檢測領域公認的大神Ross Girschick推出了R-CNN,并于2015年4月演變為Fast R-CNN,2015年6月演變為Fast R-CNN。它已經成為當今目標檢測和識別領域公認的最佳方法,并且可以完全實現端到端。FasterR-CNN也用于激光雷達的目標探測和識別。自2015年底以來,Faster R-CNN已經過去了近兩年,但它仍然是ObjectDetection領域的主流框架之一。盡管已經引入了改進的框架,如R-FCN和Mask R-CNN,但基本結構沒有太大變化。同時,還有許多新作品,如SSD和YOLO,但Faster R-CNN在準確性方面仍然是最好的。從本文中的RCNN到快速RCNN,再到fast RCNN,目標檢測的四個基本步驟(候選區域生成、特征提取、分類和位置細化)最終統一為一個深度網絡框架。所有計算都不重復,完全在GPU中完成,大大提高了運行速度。

4 2013年11月,目標檢測領域公認的大神Ross Girschick推出了R-CNN,并于2015年4月演變為Fast R-CNN,2015年6月演變為Fast R-CNN。它已經成為當今目標檢測和識別領域公認的最佳方法,并且可以完全實現端到端。FasterR-CNN也用于激光雷達的目標探測和識別。自2015年底以來,Faster R-CNN已經過去了近兩年,但它仍然是ObjectDetection領域的主流框架之一。盡管已經引入了改進的框架,如R-FCN和Mask R-CNN,但基本結構沒有太大變化。同時,還有許多新作品,如SSD和YOLO,但Faster R-CNN在準確性方面仍然是最好的。從本文中的RCNN到快速RCNN,再到fast RCNN,目標檢測的四個基本步驟(候選區域生成、特征提取、分類和位置細化)最終統一為一個深度網絡框架。所有計算都不重復,完全在GPU中完成,大大提高了運行速度。 4

4

圖像語義分割可以說是圖像理解的基石技術,在自動駕駛系統(具體而言,街景識別和理解,判斷駕駛區域)、無人機應用(著陸點判斷)和可穿戴設備應用中發揮著重要作用。圖像由許多像素組成,顧名思義,“語義分割”是根據圖像中表達的不同語義對像素進行分組/分割。語義分割有時是最困難的部分,因為它需要NLP自然語言處理的技能,而大多數玩CNN的人對NLP不是很了解。

5

5

上圖為斯坦福大學激光雷達語義分割的流程圖。最后,使用3D FC-RF,即完全連接的條件隨機場。另一種常用的方法是MRF和馬爾可夫隨機場。將條件隨機場用于自然語言處理,如序列標記和數據分割,取得了良好的效果。它在中文分詞、中文名稱識別和歧義解決等方面都有應用。百度的語義分割主要是為了更好地理解流量場景,為行為決策提供依據。低成本無人駕駛還可以利用攝像頭的2D圖像進行語義分割,找出無人車的駕駛區域。這種低成本的方案可以在光線好的情況下使用。除了激光雷達,2018年CES展出的Apollo2.0無人車頂部增加了兩個攝像頭,一個長焦和一個短焦,主要用于識別道路上的紅綠燈。自動駕駛訓練數據集KITTI數據集是由德國卡爾斯魯厄理工學院和豐田美國理工學院共同創立的自動駕駛場景中的計算機視覺算法評估數據集。該數據集用于評估計算機視覺技術在車輛環境中的性能,如立體圖像、光流、視覺里程計、3D物體檢測和3D跟蹤。KITTI包含從城市、農村和高速公路場景中收集的真實圖像數據,每張圖像中最多有15輛汽車和30名行人,以及不同程度的遮擋和截斷。

6

6

Cityscapes數據集主要由梅賽德斯-奔馳公司推廣,提供無人環境下的圖像分割數據集。它用于評估視覺算法在城市場景語義理解方面的性能。城市景觀包含了50個城市不同場景、背景和季節的街景,提供了5000張精細標記的圖像、20000張粗略標記的圖像和30種標記的物體。3月8日,百度正式開通ApolloScape大型sc……

e自動駕駛儀數據集。ApolloScape的數據是Cityscapes等類似數據集的10倍以上,包括感知、模擬場景和路網數據等數十萬高分辨率圖像數據,這些數據被逐像素進行語義分割和標記,進一步覆蓋了更復雜的環境、天氣和交通狀況。ApolloScape數據集涵蓋了更復雜的道路條件,例如單個圖像中多達162輛車輛或80名行人,開放數據集采用逐像素的語義分割和標記。Kitti、Cityscapes和ApoloScape的數據示例比較

7

7

對于中國的傳統汽車制造商來說,自建培訓數據集可能是最大的問題,與百度合作是最好的選擇。3月31日,北京“你好Apollo,自動駕駛公開課”在2018年CES上,百度發布了Apollo 2.0,搭載百度Apollo 2.0-系統的自動駕駛汽車將具備簡單城市道路的自動駕駛能力。Apollo 2.0的發布也意味著百度的整體自動駕駛系統已經開放,包括云服務平臺、軟件平臺、參考硬件平臺和參考車輛平臺。阿波羅自動駕駛公開課程第三期將于3月31日在北京舉行,將引導自動駕駛開發者深入應用Apollo2.0。本次公開課邀請了百度自動駕駛部門的高級工程師和Apollo的老用戶與開發者交流,快速掌握Apollo2.0的最新功能。負責產品解決方案的百度自動駕駛事業部高級架構師楊帆將介紹Apollo開放平臺的引入、Apollo能力開放、Apollon資源開放和研發迭代的新模式以及Apollo生態舞臺的成果。設計并建造Apollo多傳感器融合定位系統的百度無人車定位技術負責人萬國偉將介紹Apollo2.0多傳感器融合導航模塊。無人車定位技術是自動駕駛領域的基礎技術之一,其難點在于如何保證高精度和高魯棒性。Apollo2.0的多傳感器融合定位模塊自適應地使用GNSS、激光雷達和IMU等傳感器,并在許多具有挑戰性的場景(如城市地區和隧道)中實現厘米級定位。萬國偉的演講將分享定位模塊的框架以及每個子模塊的算法原理。長沙智能駕駛研究院產品部負責人黃英軍從事智能駕駛的整體解決方案和產品研發,并將在沙龍上介紹“Apollo分布式可擴展計算平臺的探索”。黃英俊的分享主要包括:Jetson TX2上的Docker擴展和運行Apollo

; 在Jetson TX2上的Apollo中配置了TensorRT和VisionWorks的自適應功能,以優化和加速視覺算法。智行哲科技聯合創始人&;技術研發部總監李曉飛將在沙龍上分享“智能駕駛員案例——阿波羅合作落地低速自動駕駛專用車產品”,主要包括自動駕駛落地場景和應用挑戰、智能駕駛員AVOS系統的研發、,以及Intelligent Driver與Apollo之間的技術合作。

8

8

9

9

演講者簡介

0

0

楊帆:百度自動駕駛事業部高級架構師,負責產品解決方案。演講摘要:阿波羅開放平臺介紹、阿波羅能力開放介紹、阿波羅資源開放和研發迭代新模式、阿波羅生態階段成果。

1

1

萬國偉:百度無人車定位技術和Apollo核心算法技術負責人,設計并構建了Apollo多傳感器融合定位系統。摘要:無人車定位技術是自動駕駛領域的基礎技術之一,其難點在于如何保證高精度和高魯棒性。Apollo2.0的多傳感器融合定位模塊自適應地使用GNSS、激光雷達和IMU等傳感器,并在許多具有挑戰性的場景(如城市地區和隧道)中實現厘米級定位。本次講座將分享定位模塊的框架以及每個子模塊的算法原理。

2

2

黃英軍:長沙市智能駕駛研究院產品部部長,從事智能駕駛整體解決方案和產品研發,探索Apollo的分布式擴展。摘要:隨著智能駕駛技術平臺和系統架構的快速發展,許多制造商都提出了自己的系統架構和解決方案,但目前還沒有占主導地位的解決方案。Apollo集中運行感知、決策和控制模塊,對資源、實時性能和可靠性有不同要求,對計算平臺、操作系統和運行環境也有不同要求。我們共享的是,這些模塊是解耦的,并以分布式和集成的方式在不同的計算平臺和操作系統上運行,即決策和控制模塊在高度可靠的雙機備份低成本平臺上運行,并且傳感模塊在幾個低成本和高性能的技術平臺上運行,以實現分布式和可擴展的解決方案。這種共享主要包括:Jetson TX2上的Docker擴展和運行Apollo;在Jetson TX2上的Apollo中配置了TensorRT和VisionWorks的自適應功能,以優化和加速視覺算法。

3

3

李曉飛:智行哲科技聯合創始人;技術研發部部長。演講摘要:自動駕駛產品落地為何如此困難?困惑,自動駕駛應用場景的出路在哪里?團結就是力量,智者和阿波羅怎么能齊頭并進?本文主要介紹了自動駕駛著陸場景及應用挑戰、智能步行者AVOS系統的研發以及智能步行者與Apollo的技術合作三個部分。

4

4

3月21日,寶馬集團在德國慕尼總部召開了每年一度的全球年會,就財報的關鍵數字、未來規劃和全球市場的布局發布了一系列重要數據和關鍵信息。

1900/1/1 0:00:003月21日,億歐汽車在位于北京理工大學中關村校區國防科技園的新能源汽車國家監測與管理中心辦公區前,遇到了三位法拉第未來(FF)的工作人員。

1900/1/1 0:00:003月21日,吉利汽車控股有限公司發布了2017年全年財報公告,截至2017年12月31日,吉利汽車總營收92761億元,同比增長73,此前市場預估9426億元;全年凈利潤106

1900/1/1 0:00:00A輪5億元融資的消息公布后,億歐汽車在位于學院南路的行圓汽車總部見到了行圓的創始人兼CEO邵京寧。

1900/1/1 0:00:00根據英國《金融時報》研究服務部門《投資參考》的最新調查,盡管目前本土品牌仍主導中國電動汽車市場,但未來可不見得如此。由于中國政府鼓勵發展電動汽車行業而引發的“淘金熱”,或將導致行業大洗牌。

1900/1/1 0:00:00坐落于寧波市慈溪市杭州灣的吉利汽車(杭州灣)研發中心規劃于2013年,2016年正式投入使用。

1900/1/1 0:00:00